MCP

Conecte dados de qualidade diretamente a modelos de IA do mercado de forma segura, escalável e auditável.

📖 Visão geral

Conectar dados de qualidade a modelos de linguagem costuma exigir integrações sob medida, que consomem tempo, elevam custos e aumentam riscos de inconsistência.

A camada MCP (Model Context Protocol) do BigIA elimina essa complexidade ao funcionar como um conector direto e padronizado entre os dados estruturados da BigDataCorp e os principais modelos de IA do mercado, como ChatGPT e Google Gemini

Com o MCP, empresas podem enriquecer seus agentes conversacionais, dashboards e fluxos internos com informações confiáveis, atualizadas e seguras, entregues no formato do protocolo e compatível com qualquer ferramenta que suporte o MCP.

O resultado é um atalho poderoso para acelerar a adoção de IA, permitindo que times de produto, risco, compliance e atendimento utilizem dados de alta qualidade em seus próprios modelos com governança, auditabilidade e escalabilidade desde o primeiro dia.

🌟 Benefícios

Conecta dados estruturados da BigDataCorp a LLMs como ChatGPT e Gemini, sem customizações complexas.

Resultados podem ser exibidos em chatbots, dashboards internos ou qualquer app compatível com MCP.

Suporta grandes volumes de consultas sem perda de performance.

Empresas aproveitam agentes de IA existentes com dados confiáveis, sem treinar modelos do zero.

Conecte seus modelos de IA preferidos (ChatGPT, Gemini ou LLMs privados) mantendo liberdade e flexibilidade.

Sem custos adicionais ou período mínimo de contratação; pague apenas pelo consumo.

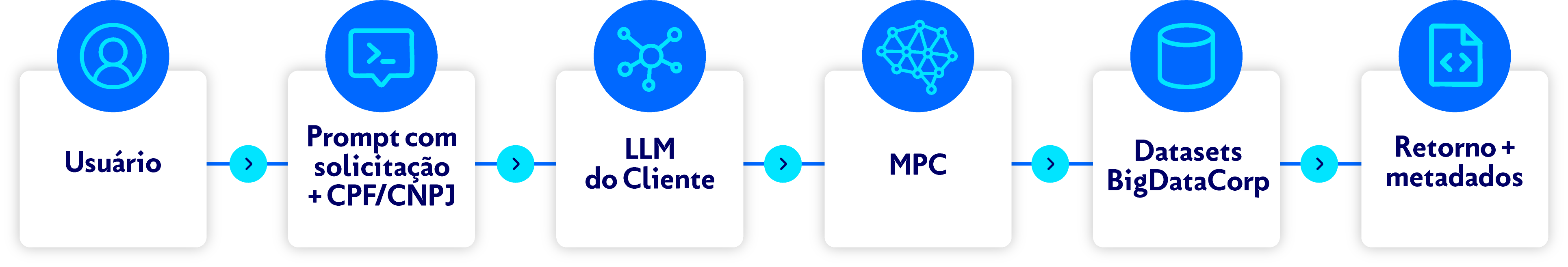

⚙️ Como funciona

A camada MCP (Model Context Protocol) foi criada para simplificar o uso de LLMs em empresas. Ela conecta os dados estruturados da BigDataCorp diretamente ao modelo de linguagem escolhido (GPT, Gemini ou proprietário), garantindo segurança, rastreabilidade e escalabilidade. O analista precisa apenas enviar um prompt com o identificador (CPF ou CNPJ). O MCP trata a solicitação, devolve os dados autorizados no formato padrão e a LLM gera a resposta em linguagem natural, pronta para uso em relatórios, dashboards ou fluxos automatizados.

Para instruções técnicas de integração, consulte as páginas MCP e exemplo de integração com MCP .

🧩 Arquitetura de referência

- Prompt inicial: o usuário envia um prompt à LLM com a solicitação e o documento de identidade (CPF/CNPJ).

- Chamada autenticada: a LLM consulta, via MCP, os dados da BigDataCorp.

- Retorno padronizado: o MCP entrega os dados no formato do protocolo.

- Resposta final: a LLM do cliente processa e apresenta a narrativa ao usuário.

Consulte exemplos em Exemplos de prompt .

Updated 3 months ago